新新貸 1元起投,開啟互聯網金融投資新紀元

在當今數字化浪潮席卷全球的背景下,互聯網金融信息服務正成為大眾理財的熱門選擇。新新貸作為該領域的創新代表,憑借其‘1元起投’的低門檻設計,為普通投資者打開了一扇便捷的財富增值之門。

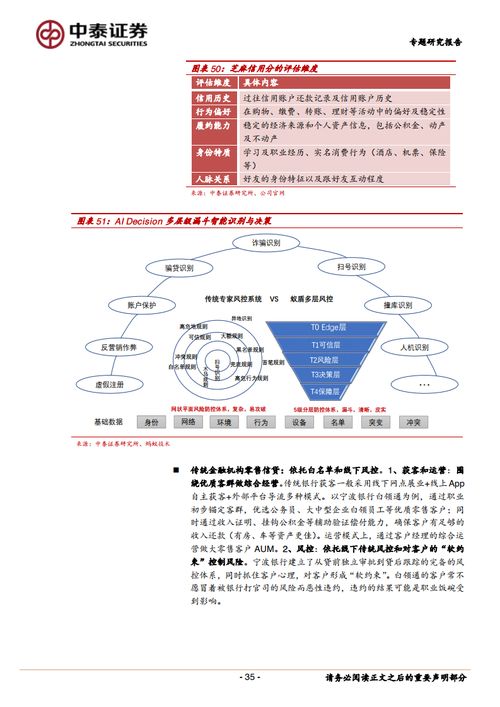

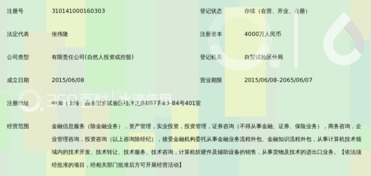

新新貸平臺專注于提供安全、透明的互聯網金融信息服務,通過智能風控系統和大數據分析,確保用戶資金的安全性和投資回報的穩定性。與傳統金融機構動輒數萬元的投資起點相比,1元起投的模式極大地降低了投資門檻,讓小額資金也能參與到多元化的理財產品中,如定期理財、靈活存取計劃等。這不僅普及了理財知識,還培養了用戶的長期投資習慣。

新新貸注重用戶體驗,提供簡潔明了的操作界面和全天候客服支持,幫助投資者輕松管理資產。隨著監管政策的完善,平臺合規運營,進一步增強了用戶的信任感。無論您是初入職場的年輕人,還是尋求資產多元化的資深投資者,新新貸都能以靈活的方式滿足您的需求。

新新貸以‘1元起投’為核心,推動了金融服務的普惠化,是互聯網金融時代的重要里程碑。趕緊行動起來,體驗智能理財的便利與樂趣吧!

如若轉載,請注明出處:http://www.imopgfb.cn/product/41.html

更新時間:2026-04-14 11:44:28